Data Mining

John Samuel

CPE Lyon

Année: 2025-2026

Courriel: john.samuel@cpe.fr

Ce processus formalise la transformation des données en informations, puis en connaissances mobilisables pour la décision.

Collecte initiale de données provenant de diverses sources.

La méthode 5W1H (Qui, Quoi, Où, Quand, Pourquoi, Comment) est essentielle pour structurer cette étape : elle permet de définir précisément la source, la nature, le lieu, le moment, la raison et la méthode de collecte des données.

Processus structuré d’intégration qui extrait, transforme et charge les données pour assurer leur qualité, cohérence et disponibilité analytique.

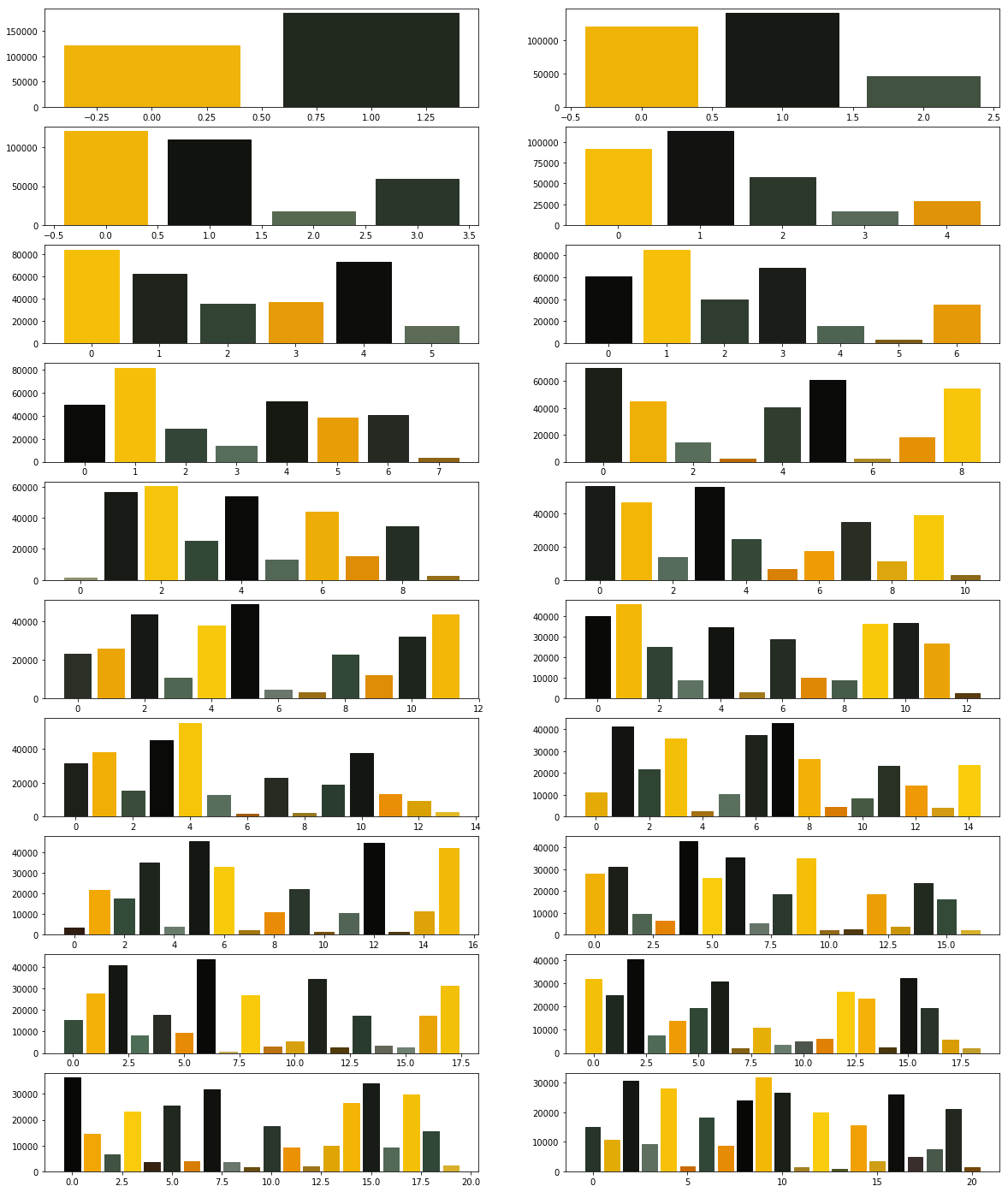

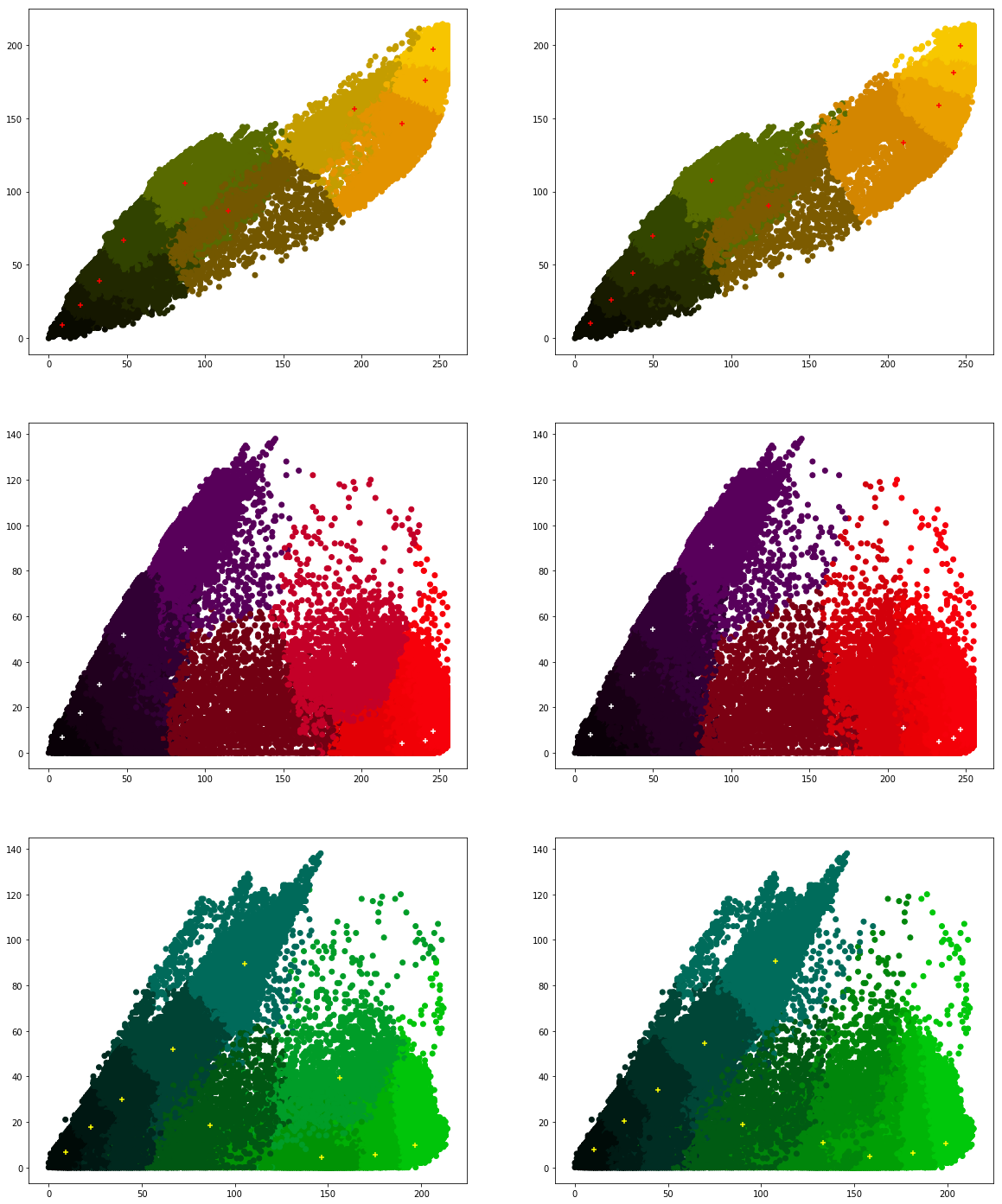

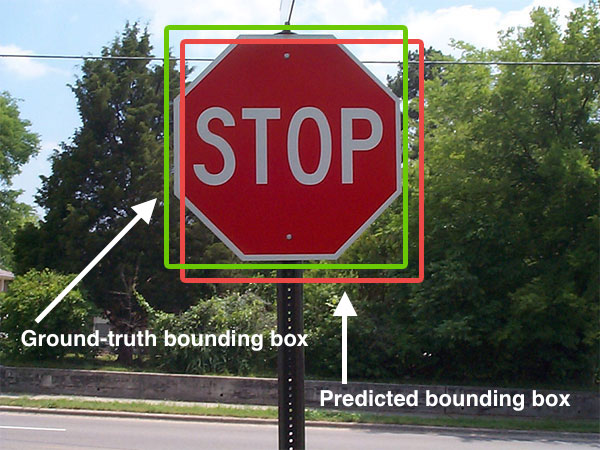

Exploration approfondie des données pour identifier des tendances significatives et des insights pertinents.

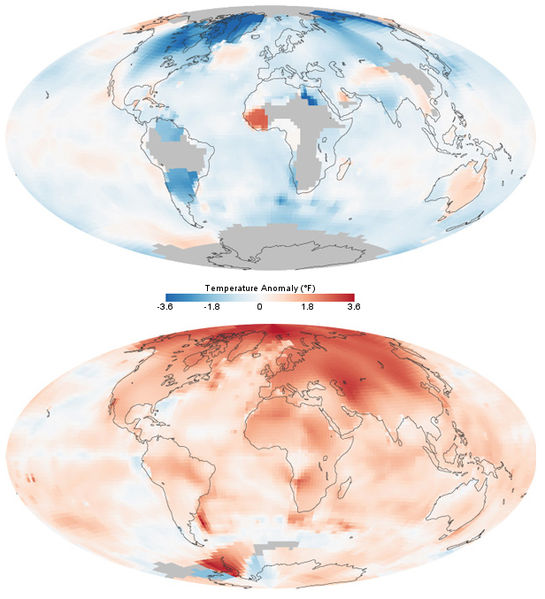

Transformation des données en représentations graphiques claires et informatives. Par exemple, graphiques, tableaux de bord, cartes pour faciliter la compréhension visuelle.

Format léger et lisible par l'homme pour représenter et échanger des données et une structure basée sur des paires clé-valeur, adaptée pour les objets complexes et les listes.

[

{

"languageLabel": "ENIAC coding system",

"year": "1943"

},

{

"languageLabel": "ENIAC Short Code",

"year": "1946"

},

{

"languageLabel": "Von Neumann and Goldstine graphing system",

"year": "1946"

}

]

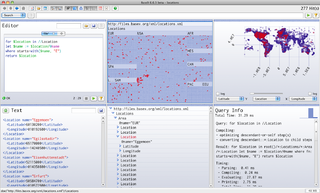

Langage de balisage polyvalent pour représenter et structurer des données de manière lisible par l'homme et la machine. XML supporte la représentation de données complexes avec des schémas définissables.

<?xml version="1.0" encoding="UTF-8"?>

<root>

<element>

<languageLabel>ENIAC coding system</languageLabel>

<year>1943</year>

</element>

<element>

<languageLabel>ENIAC Short Code</languageLabel>

<year>1946</year>

</element>

<element>

<languageLabel>Von Neumann and Goldstine graphing system</languageLabel>

<year>1946</year>

</element>

</root>

languageLabel,year ENIAC coding system,1943 ENIAC Short Code,1946 Von Neumann and Goldstine graphing system,1946

On distingue des données structurées, semi-structurées et non structurées, un cadre qui guide l’organisation, l’accès et les choix de traitement.

Trois familles selon le degré de structuration :

Cadre garantissant la fiabilité des transactions.

Ces propriétés garantissent la fiabilité et la cohérence des transactions dans les bases de données.

Dans un système distribué, on ne peut pas garantir simultanément ces trois propriétés.

Exemple : lors d'une coupure réseau, un service peut choisir de rester disponible mais retourner une donnée légèrement décalée.

Le modèle BASE privilégie la disponibilité et la réactivité, au prix d’une cohérence immédiate.

Exemple : un “j’aime” sur un réseau social apparaît d’abord localement, puis se propage aux autres serveurs.

.png)

| num | languageLabel | year |

|---|---|---|

| 1 | ENIAC coding system | 1943 |

| 2 | ENIAC Short Code | 1946 |

| 3 | Von Neumann and Goldstine graphing system | 1946 |

Exemple : une base orientée colonnes (p. ex. Cassandra, HBase) pour des mesures de capteurs horodatées, où l’on interroge souvent un intervalle de temps sur quelques colonnes.

ENIAC coding system:1; ENIAC Short Code:2 Von Neumann and Goldstine graphing system:3 1943:1; 1946:2; 1946:3

Stockage par documents (JSON/BSON) regroupant des données liées, avec schéma flexible.

Avantage : adaptation rapide aux données semi-structurées ou évolutives.

{

"languageLabel": "ENIAC coding system",

"year": "1943"

}

Exemples : MongoDB, CouchDB sont des exemples de bases de données NoSQL orientées documents.

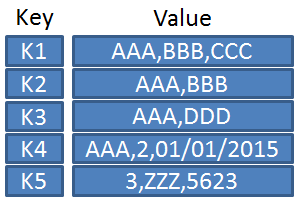

Une base clé-valeur stocke des paires clé-valeur avec des clés uniques (simples ou complexes). Très flexible, elle excelle en lecture/écriture simples et en accès rapide par clé, idéale pour des données simples et non structurées.

| identifiant | languageLabel,year |

|---|---|

| p1 | ENIAC coding system,1943 |

| p2 | ENIAC Short Code,1946 |

Exemples : Redis, Amazon DynamoDB sont des exemples de bases de données NoSQL orientées clé-valeur.

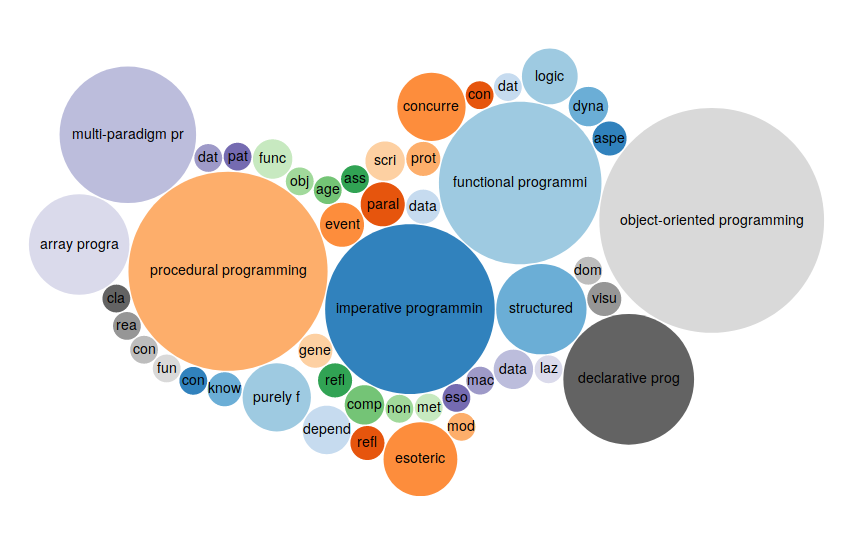

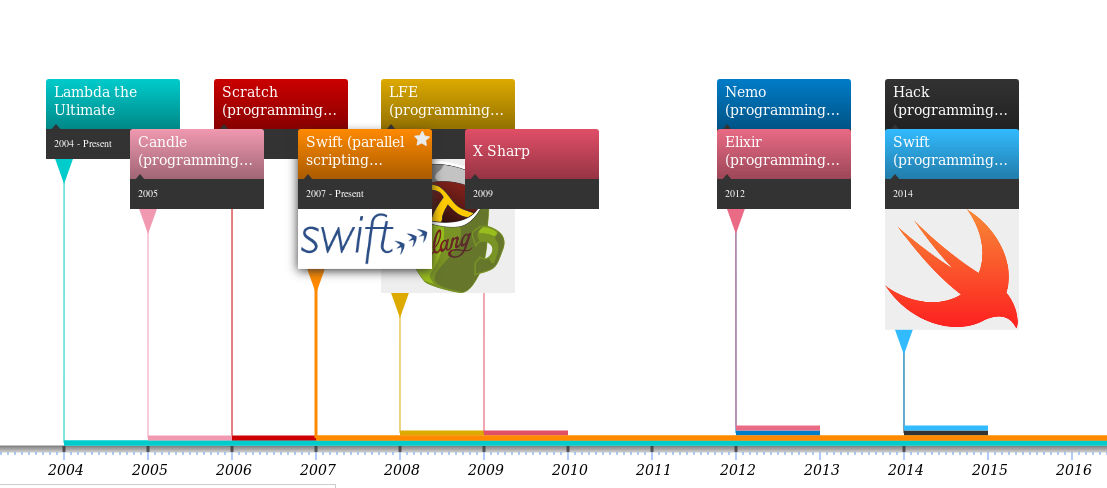

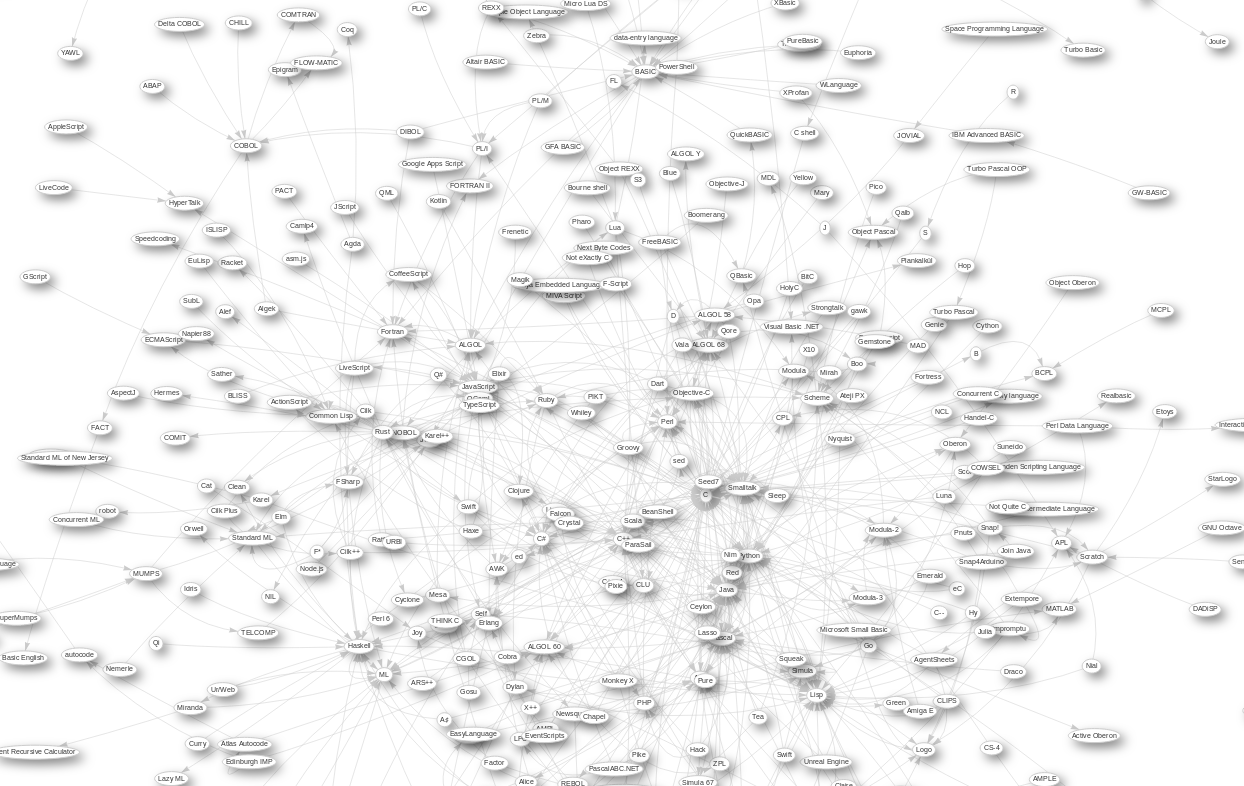

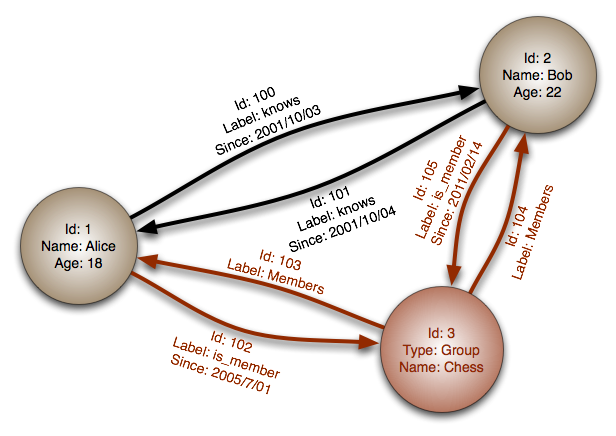

Deux types de nœuds : langage de programmation et année. L’arête year relie un langage à l’année de sa première version.

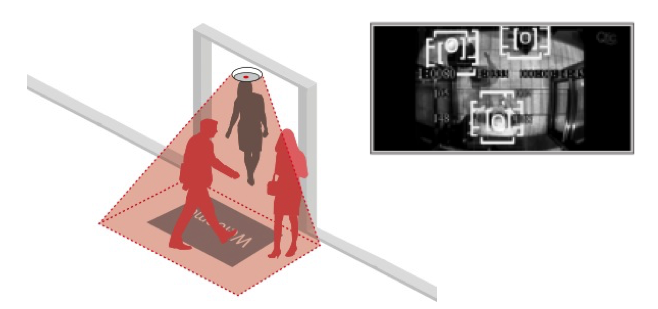

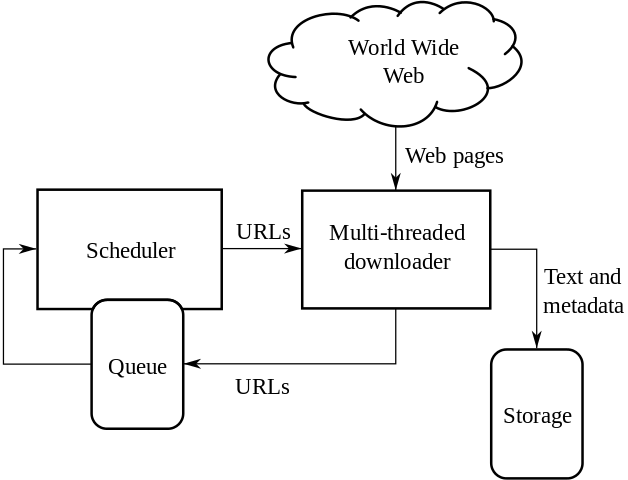

Les crawlers, également appelés robots d'indexation, sont des programmes qui parcourent et analysent automatiquement les pages web pour collecter des informations. Les crawlers naviguent de page en page en suivant les liens, extrayant des données pertinentes telles que le contenu, les liens hypertextes, les balises méta, etc.

import requests

url = "https://api.github.com/users/johnsamuelwrites"

response = requests.get(url)

print(response.json())

Identifie et corrige les anomalies pour garantir la qualité des données

<xs:schema attributeFormDefault="unqualified"

elementFormDefault="qualified" xmlns:xs="http://www.w3.org/2001/XMLSchema">

<xs:element name="root" type="rootType"/>

<xs:complexType name="elementType">

<xs:sequence>

<xs:element type="xs:string" name="languageLabel"/>

<xs:element type="xs:short" name="year"/>

</xs:sequence>

</xs:complexType>

<xs:complexType name="rootType">

<xs:sequence>

<xs:element type="elementType" name="element" maxOccurs="unbounded" minOccurs="0"/>

</xs:sequence>

</xs:complexType>

</xs:schema>

L'élimination des doublons implique la suppression d'enregistrements redondants en utilisant des contraintes d'intégrité, comme les dépendances fonctionnelles.

Exemple : Identifier les colonnes pertinentes qui définissent la duplication (par exemple, 'Colonne1', 'Colonne2'). Appliquer la suppression des doublons en conservant uniquement la première occurrence.

| num | languageLabel | year |

|---|---|---|

| 1 | ENIAC coding system | 1943 |

\({num}\rightarrow{languageLabel}\)

\({languageLabel}\rightarrow{year}\)

\({num}\rightarrow{year}\)

Déplacer efficacement les données des sources, telles que bases de données internes/externes et services web, vers les destinations, incluant entrepôts de données d'entreprise et entrepôts web, pour faciliter l'analyse.

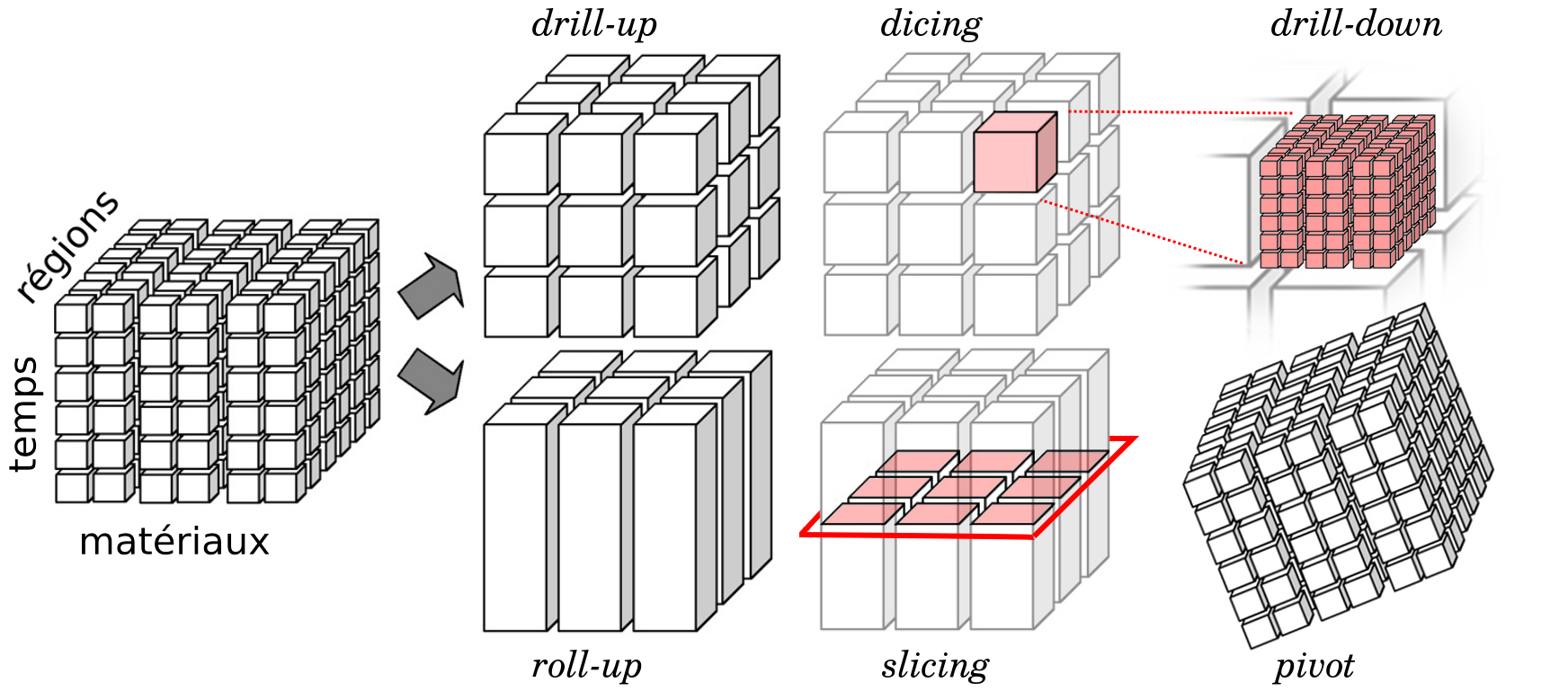

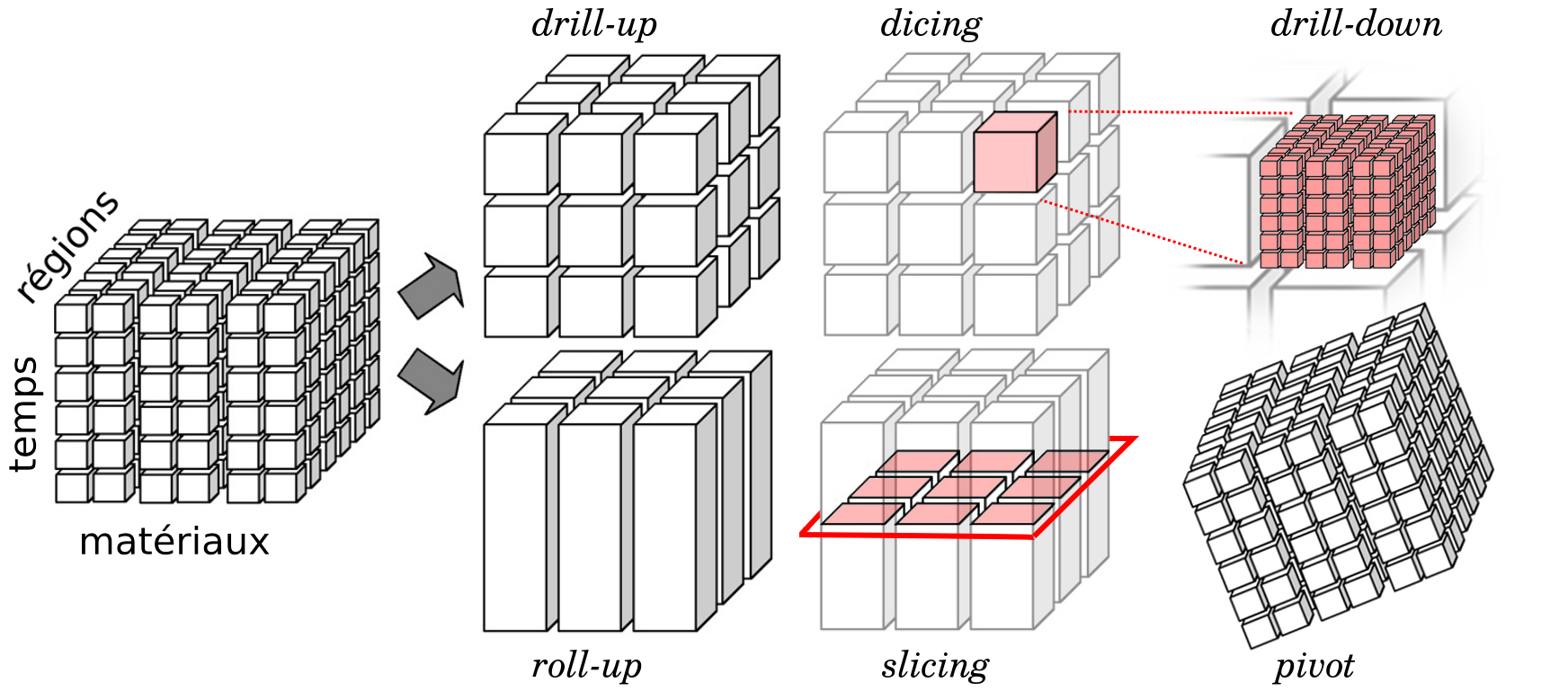

Exploration des données selon plusieurs dimensions pour une compréhension approfondie. L'approche 5W1H permet de mieux contextualiser l'analyse : Qui (Client), Quoi (Produit), Où (Lieu), Quand (Temps), Pourquoi (Promotion), Comment (Canal de vente).

Dimensions :Les aspects sous-jacents des données qui sont analysés.

Faits : Les mesures quantitatives associées aux dimensions, fournissant les données à analyser.

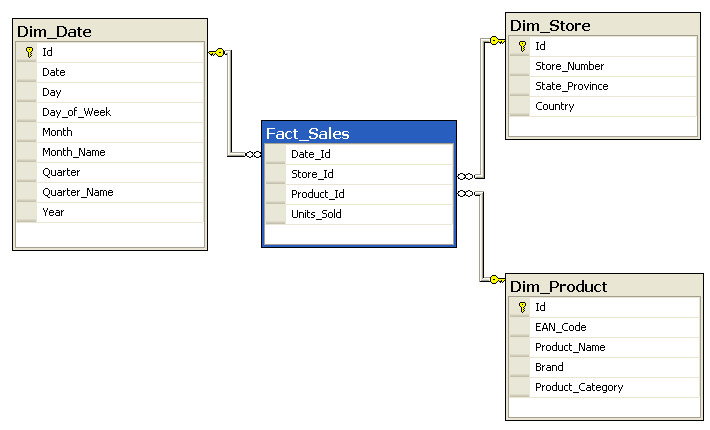

Le modèle de données en étoile est une architecture de base de données conçue spécifiquement pour faciliter l'analyse et le reporting dans les entrepôts de données.

Dans le modèle de données en étoile, les cubes de données, également appelés hypercubes, sont des structures multidimensionnelles qui permettent une analyse approfondie.

Cubes de Données pour le Traitement Analytique en Ligne (OLAP) : - Les cubes de données sont essentiels pour les systèmes OLAP, facilitant l'analyse multidimensionnelle.Les opérations OLAP permettent aux utilisateurs d'interagir avec les cubes pour obtenir des analyses spécifiques.

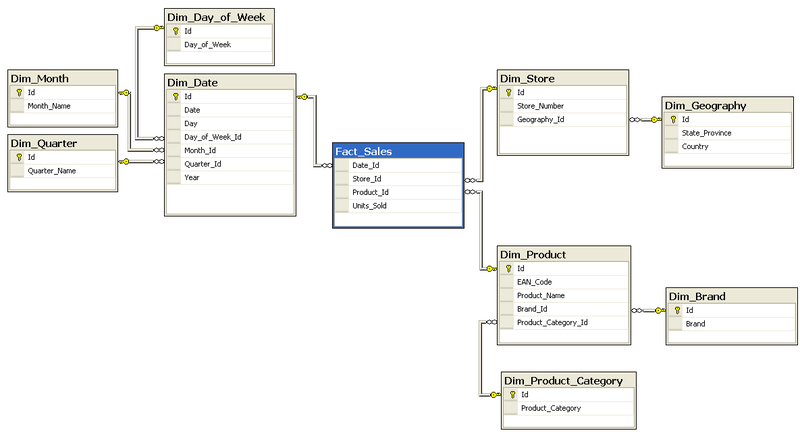

Le modèle de données en flocon est une variante du modèle en étoile, conçu pour réduire la redondance en normalisant les dimensions.

Variables visuelles essentielles pour représenter les données.